iWeekly

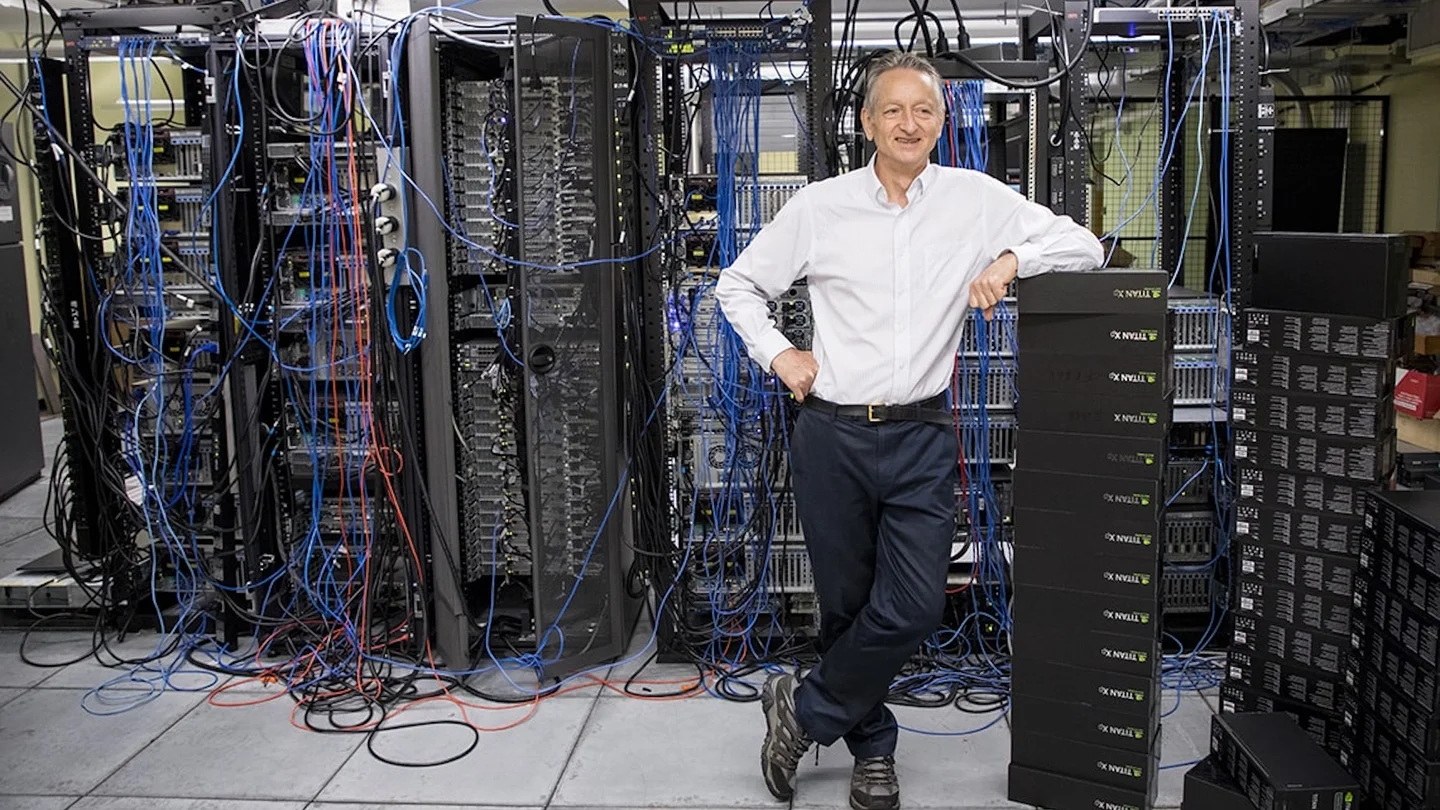

根据《纽约时报》的采访,拥有“AI教父”之称的杰弗里·辛顿(Geoffrey Hinton)表示已于四月辞去了谷歌副总裁的职务,目的是为了能不受约束地警告人们警惕AI的潜在风险。杰弗里·辛顿担心谷歌会为了和ChatGPT、Bing等服务竞争,而放松对使用AI的约束,而这可能会引发一系列的伦理问题。他说道:“我对自己毕生的工作,感到非常后悔。我用一个借口来安慰自己,如果我没有这么做,还会有其他人。”

AI风险是主要离职原因

根据采访来看,引发杰弗里·辛顿辞职担忧情绪的因素,有近期和远期两个方面。在短期内,辛顿认为生成性AI创造虚假文本、图片和影像,而在未来人工智能不仅会消灭“繁重的工作”,许多从业工作者都可能被AI取而代之。从长远来看,辛顿对完全自主武器诞生的可能性以及AI模型从训练数据中习得的行为趋势都感到非常担忧。虽然目前许多问题都只存在于理论层面,但辛顿认为若没有及时准备好相关法规和有效的控制措施,那人类将在未来对AI彻底失去控制。

事实上,辛顿曾认为AI可以拥有比人类更聪明的想法,但他没想到AI的发展速度会像过去7个月那样快。去年谷歌、OpenAI等公司都已经开始开发优于人类智慧的AI系统,辛顿对AI的立场就开始发生转变。他认为AI在未来五年可能发生的事情将是“非常可怕”的。不过目前为止,谷歌首席科学家杰夫·迪恩(Jeff Dean)强调他们仍将致力于采取“负责、对人有益的方法”,并对“可能出现的新风险”保持警惕。

“AI是个威胁”——不少科学家都提过这种论调,业界曾有不少专家都曾提议放慢AI的发展节奏。GPT-4开发后,以马斯克、美国电脑工程师斯蒂夫·沃兹尼亚克(Steve Wozniak)等为首的多名科技领袖在三月末时签署了公开信,呼吁人工智能实验室和相关企业在至少六个月内不要开发超过GPT-4的技术。此次辛顿离开谷歌以及所发表的言论不得不让普通用户更加担忧AI对人类未来的无限威胁。

以神经网路研究获得图灵奖

1972年,辛顿开始了他的研究生生涯。他的研究重点是神经网路研究——一种通过分析数据来学习技能的数学系统。当时,很少有研究人员相信这个观点。但辛顿刻苦研究,于2012年与自己的两名学生建立了一个神经网路。这个网路可以分析数千张照片,并自学识别花、狗和汽车等常见物体。之后,辛顿与自己的两名学生创建了科技公司DNNresearch,背后就采取了神经网路这种突破性概念。

2018年,辛顿与法国计算机科学家杨立昆(Yann LeCun)和加拿大计算机科学家约书亚·本希奥(Yoshua Bengio)一起因对神经网路的研究获得了2018年的图灵奖,而神经网路正是ChatGPT、Bard等聊天机器人背后的奠基性技术。辛顿的学生伊尔亚·苏茨克维(Ilya Sutskever)也是OpenAI的创始人和首席科学家。

OpenAI的创始人和首席科学家伊尔亚·苏茨克维(Ilya Sutskever)。

OpenAI的创始人和首席科学家伊尔亚·苏茨克维(Ilya Sutskever)。

也就在这时,谷歌、 OpenAI和其他科技公司开始构建从大量数字文本中学习的神经网路。那时辛顿认为这是机器理解和产生语言的一种强大方式,因此对AI的未来抱有无限憧憬和美好期待。2022年,随着谷歌和OpenAI利用大量数据构建超强AI,辛顿的观点也发生了重大转变。他虽然认为这些系统在某些方面仍不如人类的大脑,但它们在其他方面正在超越人类的智力,并在未来取代人类。3月GPT-4发布时,辛顿曾表示:“毛虫吸取了营养之后,就会化茧为蝶。而人类提取了数十亿个理解的金块,GPT-4,就是人类的蝴蝶。”

从当时的称赞到如今对AI的担忧,科技巨头们进行的这场竞争最终无法逆转。辛顿曾说过:“我们几乎已经让计算机学会如何自我改进,这很危险,我们必须要控制它们。”更重要的是,GPT-4叠代会对人类构成威胁,强AI从大量数据中能够学到意想不到的行为,也许有一天杀人机器人真的会成为现实。

有人认为辛顿对AI的看法太消极,但也有人认为辛顿的提示是出于一个计算机科学家本身的良心。因对AI的担忧而离职,不知在科学界,辛顿是否是最后一人。

新闻与图片来源:纽约时报,部分图片来自网络

iWeekly周末画报独家稿件,未经许可,请勿转载

© 2014 现代传播 Modern Media Co,Ltd.

© 2014 现代传播 Modern Media Co,Ltd.