iWeekly

人工智能打造的虚拟世界会是怎样?根据一篇预印本学术论文,斯坦福大学和谷歌的研究人员创造了一个类似于《模拟人生》的微型虚拟世界,其中25个角色由ChatGPT和自定义代码控制,通过尽可能地模仿人类的行为在这个RPG(角色扮演游戏)风格的封闭世界中生活和互动。“生成式智能体(generative agents)醒来,做早餐;然后去工作;艺术家作画,作家写作;他们形成意见,互相关注,并发起对话;他们在计划第二天行程的同时记住并反思过去的日子。”研究人员在这篇题为《生成式智能体:人类行为的互动模拟》(Generative Agents: Interactive Simulacra of Human Behavior)的论文中写道。

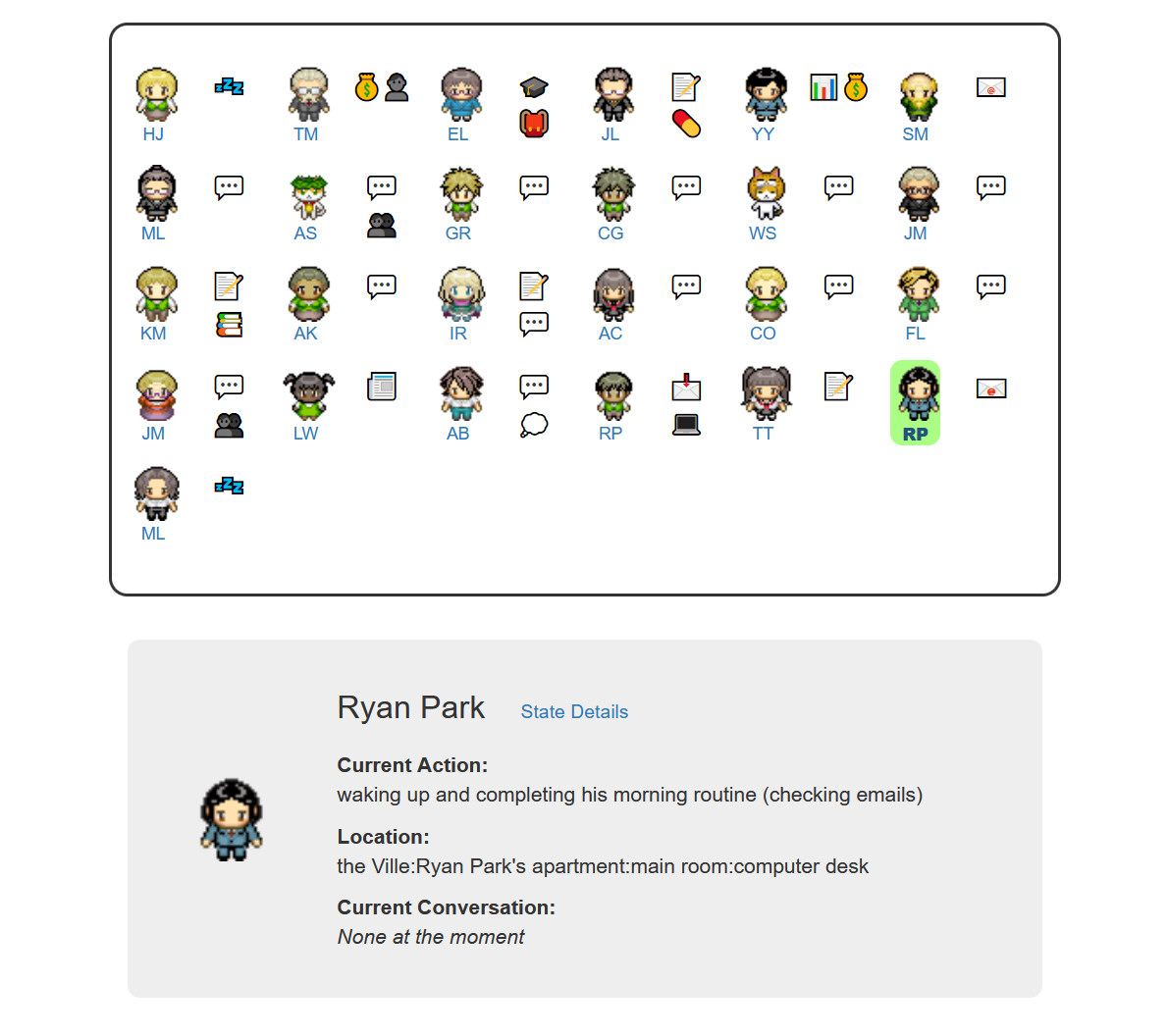

▲小镇缩略图。

由人工智能体构成的虚拟世界

这个虚拟世界中的社会互动很大程度上依赖大型语言模型(LLM),具体来说是ChatGPT API。研究人员创建了一个利用记忆和经验来模拟思维的框架,然后让智能体在其中自由互动。除此之外,人类也可以与智能体互动。论文中写道:“用户可以在智能体安排生活、分享新闻、形成关系,以及协调团体活动的过程中进行观察和干预。”

为了研究这些人工智能体,研究人员建立了一个名为“Smallville”的虚拟城镇,里面有咖啡馆、公园、杂货店和公寓等。为了展现人与人之间的互动,这个虚拟城镇在屏幕上以俯视的方式呈现出来,复古的像素风格,让人联想起经典的16位RPG游戏。

▲不同角色。

小镇由15个不同的人组成,一开始研究人员会在ChatGPT上输入一段描述,作为每个智能体的种子记忆。这段描述包含每个智能体的职业以及他们与其他智能体的关系。比如对约翰·林的描述就是:“(他)是Willow市场和药店的一名店员,喜欢帮助别人。他一直在寻找让顾客更方便拿药的方法。约翰·林的妻子梅·林是一名大学教授,儿子艾迪·林在学习音乐理论。约翰·林非常爱他的家人。”

兴趣和行为模式在互动中形成

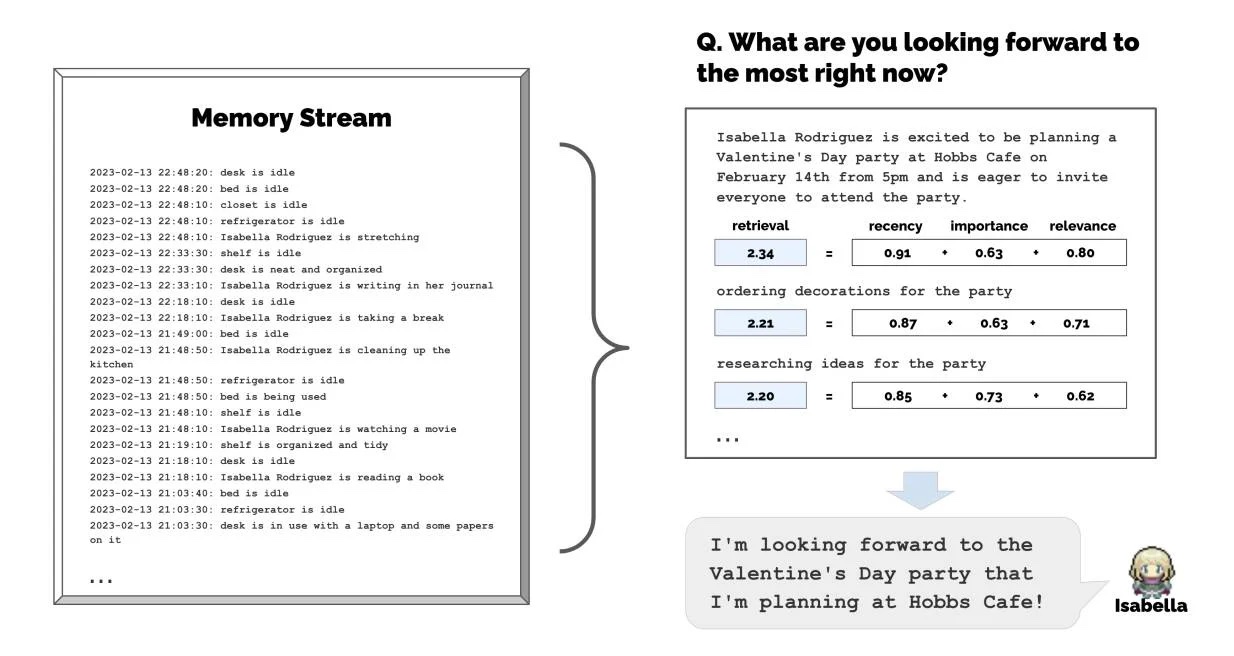

这些生成式智能体能从他们的“记忆”中检索信息,而这些记忆是智能体经历的全面记录。智能体能够感知环境,然后使用他们的记忆来决定一个行动。智能体还能进行反思,这使得他们能够生成新的见解并制定长期的计划。研究人员在模拟运行了一段时间后“采访”了每个角色,发现他们中的一些人已经发展出了独特的职业和政治兴趣。

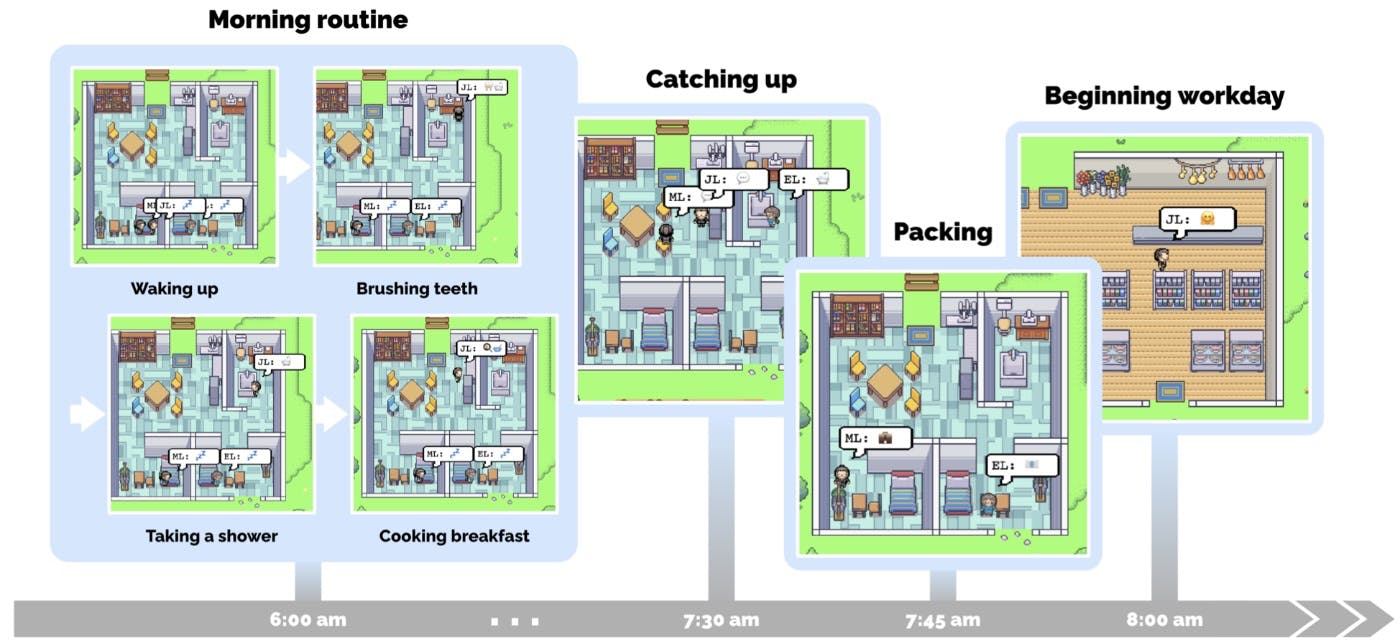

▲安排计划。

例如,小镇中的一个角色萨姆,在“参加当地政治多年后”决定竞选镇长。萨姆把他的计划告诉了其他智能体,研究人员研究了这一消息是如何在小镇上传开的。另一个角色克劳斯·穆勒则正在写一篇“研究低收入社区绅士化影响”的论文。

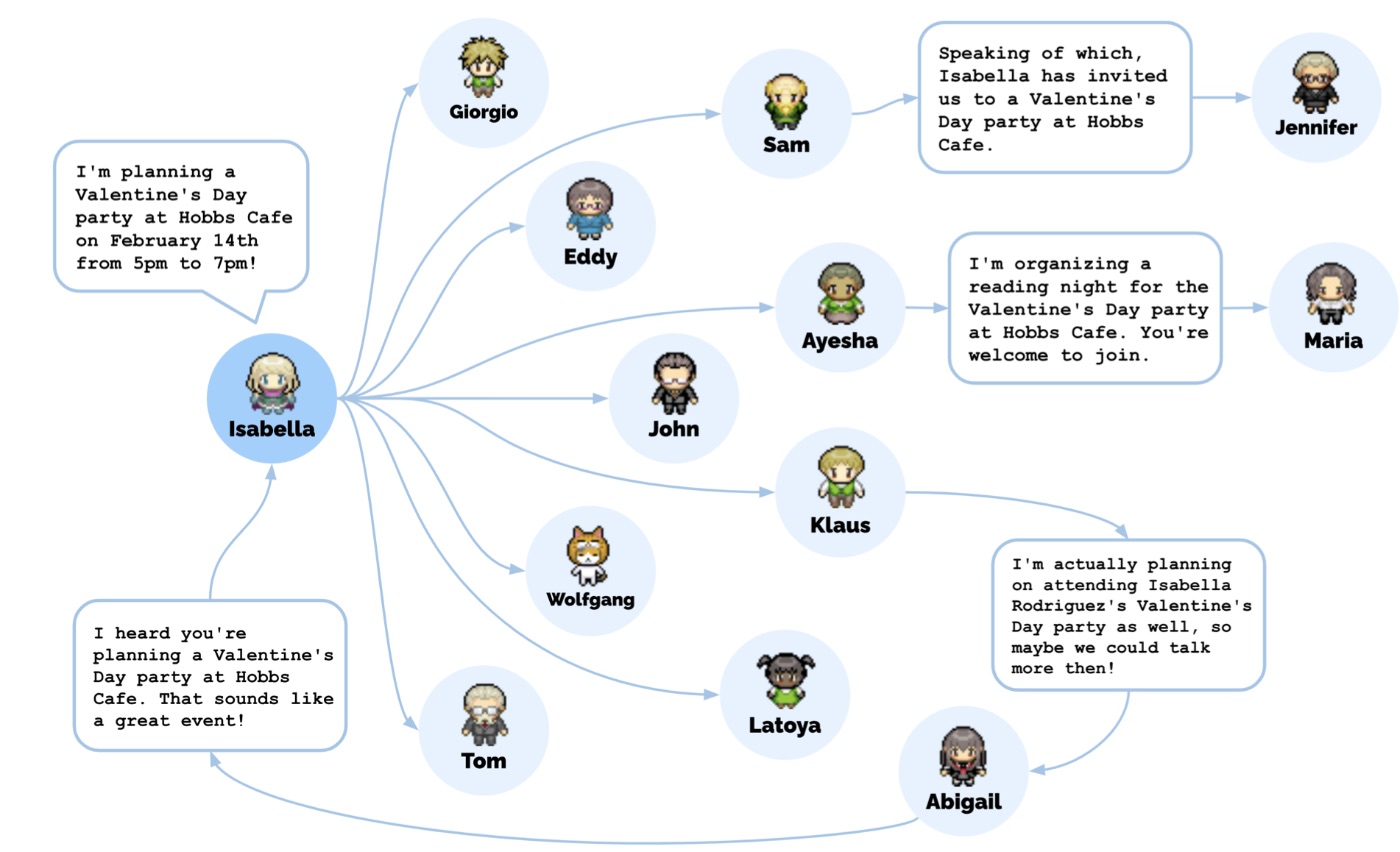

除此之外,研究人员还发现,智能体之间出现了一些行为模式。首先,智能体之间会互相分享信息;其次,智能体随着时间的推移会形成新的关系,并会记住过去他们与其他智能体的互动关系,最后,智能体之间还会相互协调。比如在情人节实验中,一名叫伊莎贝拉·罗德里格斯的人工智能体在“霍布斯咖啡馆”策划了一个情人节派对,并邀请了朋友和顾客。她在好友玛丽亚的帮助下装饰了咖啡馆,并邀请了暗恋对象克劳斯来参加。

▲情人节派对。

研究人员在论文中写道:“从单一用户指定的概念开始,即一个智能体想要举办情人节派对,其他智能体自主地在接下来的两天内传播了派对邀请,结识了新朋友,相互邀请参加派对并协调好在对的时间一起出席派对。”

虽然总共有12个智能体听说了这个派对,但真正出席的只有5人。3个人说太忙了,还有4个人没有现身。这个例子刚好展示了虚拟世界中复杂社交互动有可能产生的意外情况。

应用拓展和道德伦理风险

研究人员认为,在“Smallville”中创建可信人类行为的能力可以移植到其他虚拟空间应用中,包括在游戏中创建非玩家角色。“然后,我们在《模拟人生》风格的游戏世界中生成非玩家角色,并模拟他们的生活,通过这种方式我们展示了生成式智能体的潜力。评估表明,我们的构架创造出了可信的行为,”研究人员在论文中总结道,“展望未来,我们建议生成式智能体可以在许多互动应用中发挥作用,包括设计工具、社交计算系统和沉浸式环境。”

作为研究的一部分,研究人员还聘请了人类来观察虚拟世界的生活,以评估智能体根据其环境和经验产生可信行为的能力。此外,研究人员还要求人类代入智能体的角色来回答访谈问题,结果“完整的生成式智能体架构”生成了比角色扮演人类更可信的结果。

▲从记忆到行动。

虽然生成式智能体的前景很可观,但研究人员指出,这项技术背后存在着道德和伦理风险。第一个风险是,人类可能会与生成式智能体形成“寄生社会关系”,即便是在这种关系并不是很恰当的情况之下。第二是错误的影响,也就是应用程序根据智能体的预测对用户的目标做出了错误的结论。此外,研究人员还表示,目前有关生成式人工智能的风险同样也适用于生成式智能体,这当中包括制造虚假信息和生成恶意内容。

新闻来源:ArXiv、Ars Technica、Vice,图片来源于网络

iWeekly周末画报独家稿件,未经许可,请勿转载

© 2014 现代传播 Modern Media Co,Ltd.

© 2014 现代传播 Modern Media Co,Ltd.